Índice

El mejor contenido en tu bandeja de entrada

En el vertiginoso universo digital actual, emerge una tecnología tan fascinante como alarmante: el deepfake. Este término, que fusiona "deep learning" (aprendizaje profundo) y "fake" (falso), define contenidos multimedia —vídeos, audios e imágenes— manipulados mediante Inteligencia Artificial para crear falsificaciones hiperrealistas y virtualmente indetectables. Lo que comenzó como un experimento en foros se ha transformado en una de las herramientas de suplantación de identidad más sofisticadas y en un desafío para la ciberseguridad global.

Comprender qué es un deepfake y cómo funciona no es solo una cuestión de curiosidad tecnológica; es una necesidad para proteger nuestra identidad, la reputación de nuestras empresas y la integridad de nuestros procesos digitales. Desde fraudes millonarios a la manipulación de la opinión pública, el impacto de los deepfakes ya es una realidad tangible. Aquí veremos en profundidad esta tecnología, su funcionamiento, los riesgos para usuarios y negocios y cómo combatirla eficazmente con herramientas avanzadas de IA y biometría.

Qué es un deepfake: anatomía de un engaño digital

Un deepfake es, en esencia, un artefacto digital sintético. A diferencia de una simple edición de vídeo o fotomontaje con Photoshop, un deepfake no se edita manualmente. Se genera. Utilizando algoritmos de aprendizaje, un sistema de IA analiza ingentes cantidades de datos de una persona real (imágenes, vídeos, grabaciones de voz) para aprender a imitar su apariencia, sus gestos, sus expresiones y su timbre de voz con precisión.

El resultado es un vídeo o audio que parece completamente auténtico, donde una persona parece decir o hacer cosas que jamás hizo. La tecnología subyacente, conocida como deepfake AI, puede superponer el rostro de una persona en el cuerpo de otra, animar una fotografía o clonar una voz a partir de una muestra de apenas unos segundos.

Este nivel de realismo convierte a los deepfakes en el vehículo perfecto para la desinformación, el fraude como el robo de identidad y la ciberdelincuencia.

Tipos y ejemplos de deepfakes

Se manifiesta de diversas formas,con sus propias aplicaciones y niveles de sofisticación. Los tipos comunes más son:

- Face swap (Intercambio de rostros): es la aplicación más conocida. Reemplazar el rostro de una persona en un vídeo o imagen por el de otra. Los ejemplos iniciales, a menudo virales, involucran a famosos, como el vídeo donde el rostro del actor Steve Buscemi se superpone al de Jennifer Lawrence. Aunque pueden parecer triviales, estas técnicas son la base de fraudes de identidad más complejos.

- Lip sync (Sincronización de labios): un algoritmo manipula los movimientos de los labios en un vídeo para que se sincronicen con un audio diferente. Esto permite crear vídeos en los que una figura pública, como un político o un CEO, parece pronunciar un discurso que nunca dio. Un ejemplo fue el deepfake del CEO de Binance, quien tuvo que desmentir un vídeo manipulado que lo mostraba promocionando un proyecto.

- Voice cloning (Clonación de voz): utiliza la deepfake IA para sintetizar la voz de una persona a partir de una muestra de audio. Los sistemas más avanzados pueden clonar una voz con un alto grado de fidelidad, imitando el tono, la cadencia y la entonación. Esta técnica es la piedra angular de las estafas de vishing (voice phishing). En 2024, un empleado de una multinacional en Hong Kong fue engañado para transferir 25 millones de dólares tras participar en una videoconferencia con recreaciones deepfake de varios directivos de su empresa.

- Full body puppetry (Marioneta de cuerpo completo): es una de las formas más avanzadas. Aquí, la IA no solo manipula el rostro, sino que anima los movimientos corporales de una persona para que imite los de otra. Esto permite crear avatares hiperrealistas o controlar completamente la apariencia de una persona en un vídeo.

Diferencias con otras herramientas de suplantación de identidad

Es crucial distinguir los deepfakes de otras formas de manipulación digital más simples, a menudo denominadas "cheap fakes".

La diferencia fundamental entre un deepfake y "cheap fake" reside en su origen y realismo. Mientras que los deepfakes son generados automáticamente por IA que aprende a crear falsificaciones hiperrealistas y fluidas, los "cheap fakes" son el resultado de una edición manual con software convencional (como Photoshop), por lo que suelen presentar inconsistencias y artefactos visuales que los hacen más fáciles de detectar a simple vista.

Usos actuales de los deepfakes: cómo están afectando a usuarios y negocios

Existen aplicaciones positivas en sectores como el cine (rejuvenecimiento de actores) o la educación, pero el uso malicioso de los deepfakes predomina en el debate público debido a su devastador potencial. El principal campo de batalla es el fraude y la seguridad en los procesos de onboarding digital.

Las empresas, en su intento de digitalizar y agilizar la captación de clientes, han implementado procesos de alta u onboarding remotos. Estos procesos requieren una verificación de identidad (conocido como KYC - Know Your Customer) para cumplir con la regulación y evitar el fraude. Esto implica mostrar un documento de identidad a una cámara y realizar una prueba de vida, como sonreír o mover la cabeza.

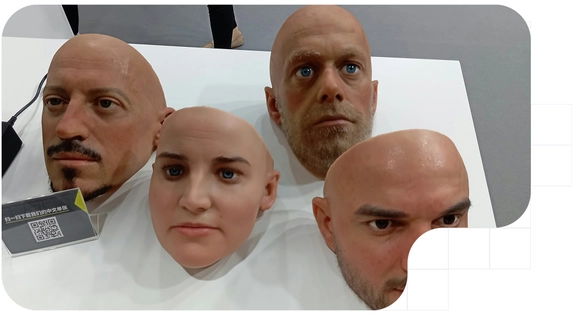

Aquí es donde los deepfakes han reventado el tablero de juego. Los ciberdelincuentes ya no necesitan máscaras físicas o actores. Utilizando una deepfake app disponible en la red y la foto de una víctima robada de sus redes sociales, pueden generar un vídeo corto que supere estas pruebas de vida básicas. Pueden animar la foto para que parpadee, sonría o mueva la cabeza, engañando a los sistemas de verificación de identidad poco sofisticados.

Este tipo de ataque, conocido como injection attack, tiene consecuencias catastróficas:

Para las empresas:

- Aumento del fraude: permite la apertura de cuentas bancarias, la solicitud de créditos o la contratación de servicios a nombre de víctimas, generando pérdidas financieras directas y un incremento en las tasas de morosidad.

- Impacto legal y de cumplimiento (Compliance): un proceso de onboarding vulnerable al fraude por deepfake incumple normativas clave como la de Prevención de Blanqueo de Capitales (AML/PBC). Las multas por incumplimiento son millonarias y el daño reputacional puede ser irreparable.

- Erosión de la confianza y las ventas: si los clientes perciben que una plataforma no es segura, la confianza se desploma. Esto no solo afecta a la retención, además frena la adquisición de nuevos usuarios, impactando directamente en el crecimiento y las ventas. La implementación de medidas de seguridad más estrictas puede generar fricción y frustración en el usuario, llevando al abandono del proceso.

Para los usuarios:

- Robo de identidad: la víctima ve su identidad utilizada para cometer delitos, lo que puede acarrear problemas legales, y un arduo proceso para limpiar su historial.

- Pérdidas financieras y chantaje: los delincuentes pueden usar la identidad robada para vaciar las cuentas de la víctima o para extorsionar o amenazar con publicar vídeos comprometedores falsos.

- Daño psicológico y reputacional: ser víctima de un deepfake puede causar estrés y angustia significativos, además de dañar la reputación personal y profesional de forma duradera.

Deepfakes e IA, ¿cómo van a evolucionar?

La evolución de los deepfakes está intrínsecamente ligada al avance de la Inteligencia Artificial. Nos encontramos en una carrera armamentística tecnológica: a medida que se desarrollan herramientas de detección, los algoritmos de generación de deepfakes se vuelven más sofisticados para eludirlas.

Las tendencias que marcarán el futuro son claras:

- Deepfakes en tiempo teal: la capacidad de generar y superponer deepfakes durante una videoconferencia o una transmisión en vivo ya no es ciencia ficción. Esto eleva el riesgo de fraude a un nuevo nivel.

- Reducción de la necesidad de datos: si los primeros deepfakes requerían miles de imágenes de la víctima, los nuevos modelos pueden generar falsificaciones creíbles a partir de una única imagen o un clip de audio

- Hiperrealismo multimodal: los futuros deepfakes no solo imitarán la cara y la voz, sino que replicarán patrones de respiración, tics nerviosos y otras señales biométricas sutiles, haciendo la detección manual prácticamente imposible.

- Expansión a nuevos dominios: veremos deepfakes aplicados no solo a humanos, sino a la creación de documentos de identidad falsos, la alteración de imágenes satelitales o la manipulación de pruebas forenses digitales.

Funcionamiento técnico de los deepfakes

Para entender cómo combatir los deepfakes, es esencial comprender su arquitectura técnica. La tecnología central detrás de la mayoría de los deepfakes son las Redes Generativas Antagónicas (Generative Adversarial Networks).

Una GAN consiste en dos redes neuronales que compiten entre sí en un juego de suma cero:

- El Generador (The Generator): su misión es crear las falsificaciones. Se le alimenta con ruido aleatorio y su objetivo es producir una imagen, vídeo, o audio que sea indistinguible del material real. Al principio, sus creaciones son burdas y caóticas.

- El Discriminador (The Discriminator): actúa como un detective o crítico. Su trabajo es recibir tanto imágenes reales (de datos de entrenamiento) como las imágenes falsas creadas por el Generador, y decidir cuáles son auténticas y cuáles no.

El proceso de entrenamiento es un ciclo de retroalimentación constante:

- El Generador crea un lote de imágenes falsas y las envía al Discriminador.

- El Discriminador evalúa y proporciona una respuesta: "esto es falso", "esto parece real".

- Esta retroalimentación se utiliza para ajustar los parámetros del Generador, que aprende de sus errores e intenta crear una falsificación mejor en el siguiente intento.

- Al mismo tiempo, el Discriminador también aprende. Al ver más ejemplos, tanto reales como falsos, se vuelve cada vez más hábil.

Este "duelo" antagónico se repite millones de veces. El Generador se vuelve un falsificador cada vez más experto, y el Discriminador se convierte en un detective cada vez más perspicaz. El ciclo continúa hasta que el Generador produce falsificaciones tan perfectas que el Discriminador ya no puede distinguirlas de las reales. En ese punto, el deepfake está listo.

Otra arquitectura común son los autoencoders, que se utilizan para los face swaps. Un autoencoder se entrena para comprimir una imagen en una representación latente de baja dimensión (la "esencia" de la cara) y luego reconstruirla. Al entrenar un autoencoder con miles de imágenes de la Persona A y otro con imágenes de la Persona B, se pueden intercambiar los "decodificadores" para reconstruir la cara de la Persona A con los atributos faciales de la Persona B.

Cómo identificar un deepfake: detectarlo con IA y APPs de KYC

Aunque los deepfakes son cada vez más perfectos, todavía existen señales de alerta. La detección manual, aunque cada vez menos fiable, puede fijarse en:

- Parpadeo y movimiento ocular anómalo: los primeros modelos de IA a menudo no replicaban bien la frecuencia natural del parpadeo.

- Inconsistencias en la iluminación y las sombras: especialmente en los bordes de la cara superpuesta.

- Artefactos digitales: Zonas borrosas o pixeladas

- Expresiones faciales poco naturales: una sonrisa que no afecta a los ojos o una falta de emoción que no se corresponde con el tono de voz.

- Sincronización labial imperfecta.

Sin embargo, confiar en el ojo humano es una estrategia perdedora. La verdadera defensa reside en la detección mediante Inteligencia Artificial, que puede analizar aspectos imperceptibles para nosotros. Estos sistemas buscan "huellas dactilares" digitales, inconsistencias en el flujo de píxeles, patrones de ruido de la cámara o señales biológicas sutiles que delatan la falsificación.

Es aquí donde las soluciones avanzadas de KYC (Know Your Customer) marcan la diferencia. Son robustos sistemas de verificación de identidad diseñados para el entorno empresarial. Como es Tecalis Identity, una plataforma que integra múltiples controles anti-deepfake directamente en el flujo de verificación, de forma invisible para el usuario.

Los controles de Tecalis Identity van más allá de pedir una sonrisa, implementando una defensa en profundidad que incluye:

- Prueba de vida pasiva y activa (Liveness Detection): analiza el vídeo en tiempo real en busca de microexpresiones, reflejos en los ojos y cambios de textura en la piel que solo un ser humano frente a la cámara puede producir.

- Análisis de profundidad 3D: mediante el análisis de luz y sombras, el sistema crea un mapa 3D del rostro para asegurarse de que no se trata de una imagen plana o un vídeo proyectado en una pantalla.

- Detección de ataques de inyección (Injection Attack Detection): La plataforma es capaz de identificar si la fuente de la cámara ha sido manipulada o si se está inyectando un vídeo pregrabado por deepfake IA.

- Análisis de comportamiento: el sistema monitoriza patrones sospechosos en el hardware, la red y el comportamiento del usuario durante el proceso, alertando ante cualquier anomalía.

Estos sofisticados controles anti-deepfake se integran también en soluciones de firma electrónica como Tecalis Sign. Al requerir una verificación de identidad biométrica robusta antes de poder firmar un contrato, se garantiza con el máximo nivel de seguridad que la persona que firma es quien dice ser. El resultado es un flujo de contratación ágil y sin fricciones.

Herramientas digitales para empresas: evitar fraudes deepfake con KYC y biometría

Para una empresa, la integración de una defensa robusta contra los deepfakes no es una opción, es una necesidad estratégica. Soluciones como las de Tecalis se ofrecen como un servicio (IDaaS - Identity as a Service) que se integra de forma sencilla y rápida en cualquier aplicación o web empresarial a través de una API (Interfaz de Programación de Aplicaciones).

Esta integración por API permite a un banco, aseguradora o empresa de telecomunicaciones añadir un proceso de verificación de identidad de máxima seguridad en cuestión de días.

- Invocación de la API: cuando un nuevo cliente inicia un proceso de alta en la web o app de la empresa, el sistema de la empresa realiza una llamada a la API de la plataforma de verificación de identidad.

- Captura segura de evidencias: la solución de Tecalis toma el control de forma segura. La tecnología OCR (Reconocimiento Óptico de Caracteres) extrae los datos automáticamente.

- Verificación biométrica y prueba de vida: el usuario graba un vídeo corto de su rostro. Durante esta grabación, la IA ejecuta en segundo plano: análisis de vida pasivo, detección de profundidad 3D, análisis de texturas, etc. Compara el rostro del vídeo con la foto del documento de identidad.

- Análisis anti-fraude: algoritmos analizan el vídeo en busca de cualquier indicio de manipulación, deepfake, o ataque.

- Respuesta y verificación: en cuestión de segundos, la plataforma completa más de 20 comprobaciones de seguridad y devuelve una respuesta a la empresa a través de la API: identidad verificada o alerta de fraude.

Este enfoque multicapa, que combina la verificación de documentos, la biometría facial y la detección de vida activa/pasiva con IA, crea un ecosistema de confianza digital. No solo blinda a la empresa contra el fraude por deepfake, sino que también garantiza el cumplimiento de las normativas más estrictas (como eIDAS), optimiza la experiencia del cliente al ofrecer un proceso rápido y sin fricciones. La amenaza de los deepfakes está en constante evolución, pero con las herramientas adecuadas, podemos estar un paso por delante, protegiendo nuestra identidad.